toine74 a écrit:- Bon, on a du retard sur le planning. Bob, tu augmentes le rythme des exo de 15% et tu allonges la durée d'exploitation de 1 heure.

- Et les gars ?

- +15 cc d'adrénaline, ça devrait le faire.

c'est sûr que des dérives sont possibles mais d'un autre côté si cela peut soulager la souffrance au travail et son impact physique ...

c'est sûr que des dérives sont possibles mais d'un autre côté si cela peut soulager la souffrance au travail et son impact physique ...il ya aussi beauoup d'applications possibles dans l'amélioration de l'autonomie des personnes à mobilité réduite

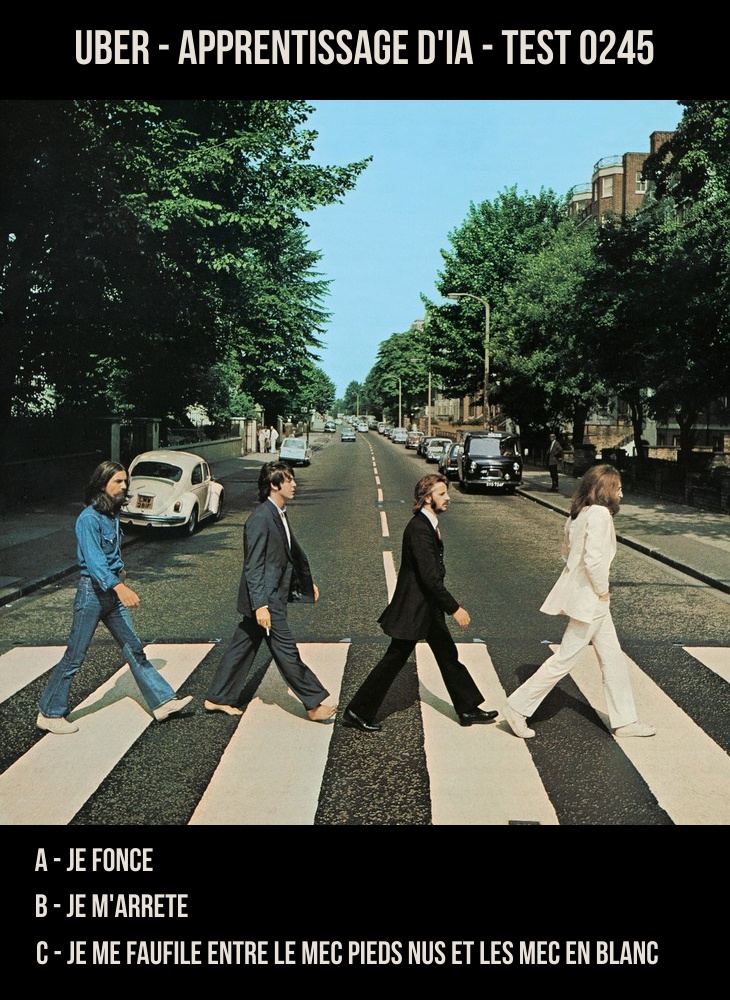

![effroi [affraid]](./images/smilies/affraid.gif) . Le choc culturel pour un français. Qui plus est parisien

. Le choc culturel pour un français. Qui plus est parisien

![Renverse [:lega]](./images/smilies/lega.gif)